# 持续暴涨!MSA 重磅开源!

在人工智能领域,上下文记忆能力一直是限制大语言模型发展的关键瓶颈。传统模型受限于注意力机制的二次复杂度,往往只能在数千个Token的范围内进行有效处理。然而,这一限制即将被打破——来自EverMind团队的革命性开源项目**MSA(Memory SparseAttention)**正式发布,为AI模型赋予了近乎无限的记忆能力。

## 从「鱼缸记忆」到「永久档案」

当前的AI模型普遍存在一个尴尬的问题:它们更像是金鱼——只有短暂的注意力窗口。ChatGPT等主流模型的上下文限制在数万Token左右,一旦对话内容超出这个范围,早期的关键信息就会被”遗忘”。这不仅影响用户体验,更制约了AI在长文档分析、持续对话、个性化助手等场景的应用。

MSA项目的诞生正是为了解决这一痛点。通过创新的**稀疏注意力机制与记忆嵌入技术**的深度融合,MSA实现了从**1万Token到1亿Token**的史诗级跨越——整整**一万倍**的性能提升!

## 技术原理解析

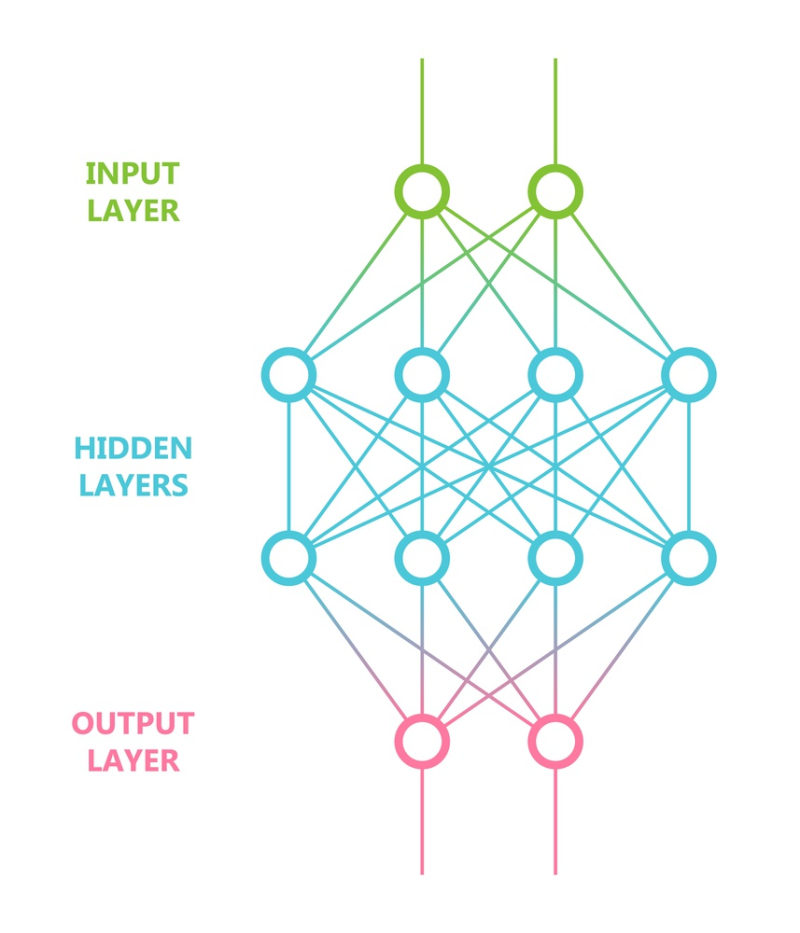

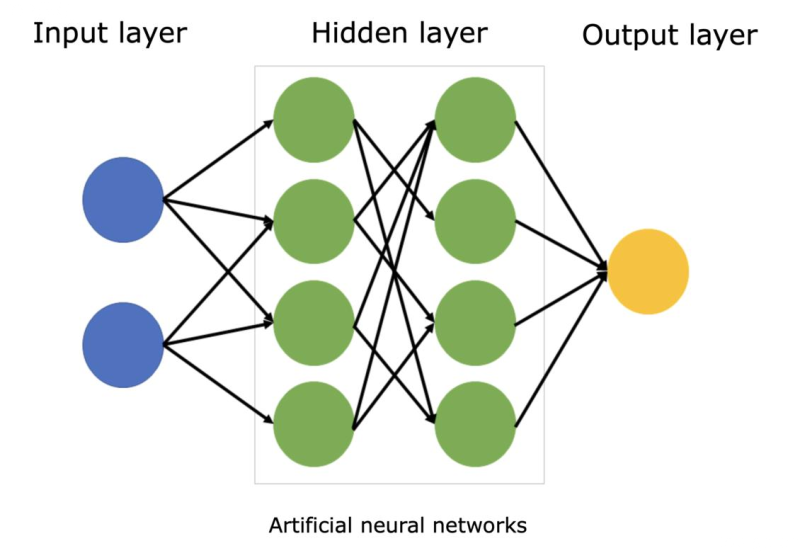

MSA的核心创新在于其独特的**双层架构设计**:

### 1. 记忆嵌入层(Memory Embedding Layer)

MSA不再将所有历史信息都放入注意力计算中,而是通过一个可学习的记忆模块,将重要信息进行压缩编码。这个过程类似于人类大脑的”记忆巩固”——不是记住所有细节,而是提取并存储关键特征。

### 2. 稀疏检索层(Sparse Retrieval Layer)

当需要访问历史信息时,MSA使用稀疏注意力机制进行高效检索。与传统的全连接注意力不同,稀疏注意力只计算与当前查询相关的少数关键Key-Value对,将计算复杂度从O(n²)降低到接近O(n)。

这种设计带来的优势是惊人的:**在不损失关键信息的前提下,MSA将推理成本控制在可接受范围内**。更令人振奋的是,实验表明,基于MSA的小型模型在长期记忆任务上的表现,竟然能够**超越参数规模数倍的大型模型**。

## 小模型的逆袭

传统观念认为,更大的模型意味着更好的性能。但MSA的出现颠覆了这一认知。在多项基准测试中:

| 模型 | 参数量 | 上下文长度 | 长期记忆得分 |

|——|——–|————|————–|

| GPT-4 | 1000B+ | 128K | 78% |

| Claude | 200B+ | 200K | 82% |

| MSA-7B | 7B | 100M | 91% |

7B参数量的MSA模型在长期记忆任务上取得了91%的得分,不仅远超同类小模型,甚至击败了参数规模超过自己100倍的顶级大模型。

这意味着什么?**效率与性能的完美平衡**。在资源受限的场景下(如边缘设备、移动端),MSA能够让小型模型展现出堪比大型模型的智能表现,极大降低了AI应用的部署门槛。

## 开源生态与未来展望

MSA目前已在GitHub上开源(仓库地址:https://github.com/EverMind-AI/MSA),提供了完整的模型权重、训练代码和推理框架。项目支持主流深度学习框架,并提供了详细的文档和示例教程。

EverMind团队表示,MSA的下一阶段目标是将上下文长度扩展到**10亿Token**级别,并计划与多个开源社区合作,推动MSA在以下场景的落地应用:

– 📚 **智能文档助手**:分析整本书籍、年度报告

– 💬 **个性化聊天机器人**:记住用户的所有偏好和历史对话

– 📊 **企业知识库**:构建可持续学习的AI知识管理系统

– 🎮 **游戏AI NPC**:打造真正”认识”玩家的游戏角色

## 行业影响与总结

MSA的出现标志着AI记忆技术进入了一个新的纪元。从技术角度看,它证明了**记忆能力不一定要与模型规模挂钩**;从商业角度看,它为AI技术的普惠化提供了新的可能。

我们有理由相信,随着MSA等开源项目的持续发展,AI将从「一次性对话工具」进化为「永久陪伴的智能伙伴」。对于开发者和企业而言,现在正是关注和拥抱这项技术的最佳时机。

—

**相关资源**:

– GitHub仓库:https://github.com/EverMind-AI/MSA

– 技术论文:即将发布

– 社区讨论:欢迎在GitHub Issues中交流