2026 年初 OpenClaw 的爆火,到最近 Hermes Agent 悄然崛起,AI Agent 应用落地的浪潮已然到来。

大家都渴望着 AI 能替代人完成各种图形界面重复性操作,于是纷纷选择给它们装上各种技能。

当多数人兴趣盎然想搞 AI 自动化时,现实却给了当头一棒。

现阶段,大部分技能依旧依赖着传统 API 对接方式,且局限于浏览器,跨桌面应用的自动化操作效果一般。

直到最近,一个名为 Mano-P 1.0 技术解决方案在 GitHub 悄然开源,其采用的 GUI-VLA 智能体模型,让每个 AI 都能拥有双手和眼镜,灵活多变的定制个性化 AI。

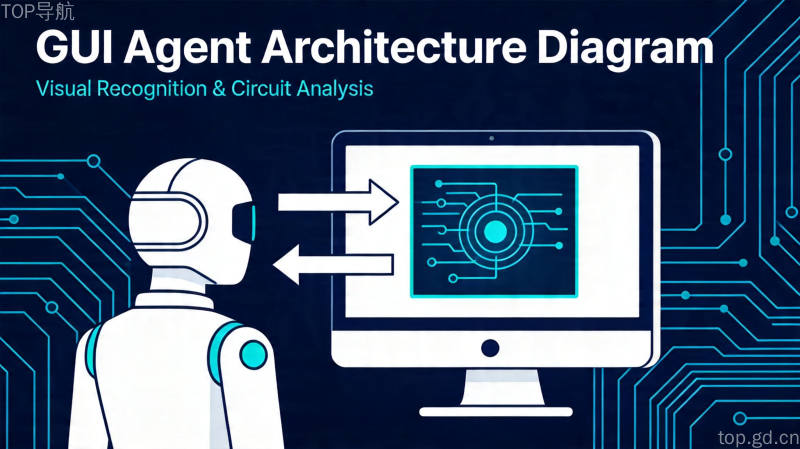

GUI Agent,指的是能看懂屏幕内容,并能自动完成操作任务的 AI Agent。

而 Mano-P 1.0,就是一个纯视觉 GUI 操作模型,不依赖任何插件,可从根本上解决兼容性问题。

在本地端侧部署,一台 M4 芯片的苹果电脑就能跑,开箱即用,数据完全在本地。

将模型接入到 OpenClaw 等 Agent 上,直接相当于拥有像人类的眼睛和手,可理解并操控界面。

除了这些核心功能外,在 GUI Agent 领域最具权威性的基准测试 OSWorld 上。Mano-P 1.0 72B 模型以 58.2% 的任务成功率,在专用 GUI 智能体模型中斩获全球第一。

放到全模型榜单里位列第五,前四名都是 Claude Sonnet 4.6、Seed-1.8 这些千亿级通用大模型。

一个面向端侧设备的小尺寸 GUI Agent 模型,能打进这个位置,实属罕见。

另外在 ScreenSpot-V2、MMBench 等 13 个多模态基准榜单,Mano-P 也全部 SOTA 拿下当前最优成绩。

覆盖了自主操控、多模态感知认知、视频理解、长上下文学习等多个关键维度,树立了 Mano-P 模型在端侧 GUI Agent 领域的性能标杆。

真正的差异化

在这些基准测试的榜单背后,真正值得我们关注的还有它与现有方案的差异。

纯视觉,不靠协议

现有大部分工具依赖 CDP 协议或 HTML 解析,本质是读取页面代码来定位按钮和输入框。

这套传统处理方式局限在 Web 应用范围内,遇到桌面软件、3D 应用便无从下手。

而 Mano-P 采用纯视觉GUI交互,可以做到直接识别屏幕截图,所见即所得,随意操控。

端侧大模型,开箱即用

另一个更显著的差别,是模型的部署方式。

OpenClaw 需要用户自行配置模型,Manus 依赖云端 API 调用。

Mano-P 模型直接支持内置端侧模型,在本地模式下,无需配 API 密钥,无需连外部服务器,可实现一键启动。

在 M4 芯片 + 32GB 内存的 Mac mini 或 MacBook 上,用 4B 量化版本就能直接跑。

在更高算力需求的场景上,接入专属算力棒,即可做到即插即用。

自适应界面改动,长任务离线运行

传统 RPA 还有一个老问题:应用界面升级改版,之前配好的自动化流程全报废。

Mano-P 靠纯视觉理解,UI 变化自适应,维护成本大幅降低。

支持数十步到上百步的复杂业务流程,全程不联网,本地完成推理、决策、纠错的完整闭环。

实用场景

官方给出的几个实际案例演示,覆盖了日常开发、工作、娱乐等几大场景。

1)Mano-afk 全自动应用构建

输入一段自然语言需求,系统自动完成架构设计、代码生成、本地部署。

测试不通过,会自动定位问题、修复、重新部署,全程无需人工介入。

2)商业级视频智能系统

从接收指令开始,自动完成视频生成、上传、分析、剪辑,再到二次评测。

过程中可自主操作网页与剪辑软件,最后输出完整的分析报告。

3)麻将博弈

Mano-P 不只是一个工作工具,官方还给出了生活娱乐场景的演示。

通过纯视觉理解麻将游戏界面,自主完成识牌、分析和出牌决策,验证了模型在非结构化场景下的通用能力。

快速安装

想使用 Mano-P 来完成 GUI 自动化任务,有两种方式。

方式一:CLI 命令行工具

在终端上,通过 Homebrew 安装 mano-cua 命令行工具:

brew tap HanningWang/tap brew install mano-cua

安装完成后,就能直接在终端下达执行任务指令:

mano-cua run "在小红书整理 AI 最新资讯,按热度排名并展示第一条帖子"

方式二:以 Skill 方式安装

有 Claude Code、OpenClaw 等 Agent 工具,可通过 ClawHub 一键安装 mano-skill:

clawhub install mano-cua

重启会话后,Agent 遇到需要操控界面的任务,会自动调用,不用手动触发。

一台 M4 芯片 Mac 电脑,两行命令,Mano-P 1.0 这个 GUI Agent 模型就能直接顺滑跑起来。

目前相关代码已开源 Mano-CUA Skill 部分,本地模型预计四月底开源。

需要注意的是,如果没有配置本地模型,工具默认会走云端模式。

写在最后

GUI Agent 这个方向,其实不算新。

从早期的 RPA 到近几年各大模型厂商推出的 Computer Use 能力,「让 AI 像人一样操作电脑」这个愿景已经被讲了很多遍。

但是,之前大多数方案都绕不开两个问题:

依赖云端 API,屏幕截图得上传,隐私上过不了关;

依赖 DOM 解析或系统 API,换个界面,AI 便容易识别错乱。

Mano-P 试图走的是一条不同的路,把模型搬到本地,用纯视觉的方式理解界面,让所有数据不出设备。

从技术指标上看,4B 模型在 M4 芯片上的推理速度已经具备实用价值,72B 模型在 OSWorld 上的表现也确实领先。

不过,这个项目真正值得关注的,可能不是当下的完成度,而是它指向的那个方向:每个人的设备上,常驻一个能理解屏幕、自主操作的 AI 助手,而且完全离线运行。

如果这条路走通了,它改变的可能不只是「自动化」这件事,而是人和计算机交互的基本方式。你不再需要学习每个软件怎么用,只需要告诉 AI 想要什么结果。

当然,从能跑 demo 到能用在生产环境,中间还有很长的路。

模型的鲁棒性、长任务中的错误累积、跨平台的适配成本,这些都是需要时间去打磨的问题。但至少,这个 GitHub 项目,让我们看到了一种新的可能性。

项目基于 Apache 2.0 协议开放,可商用和二次开发。感兴趣的同学,可以去 GitHub 仓库看看源码和文档。

GitHub 项目地址: https://github.com/MININGLAMP-AI/MANO-P